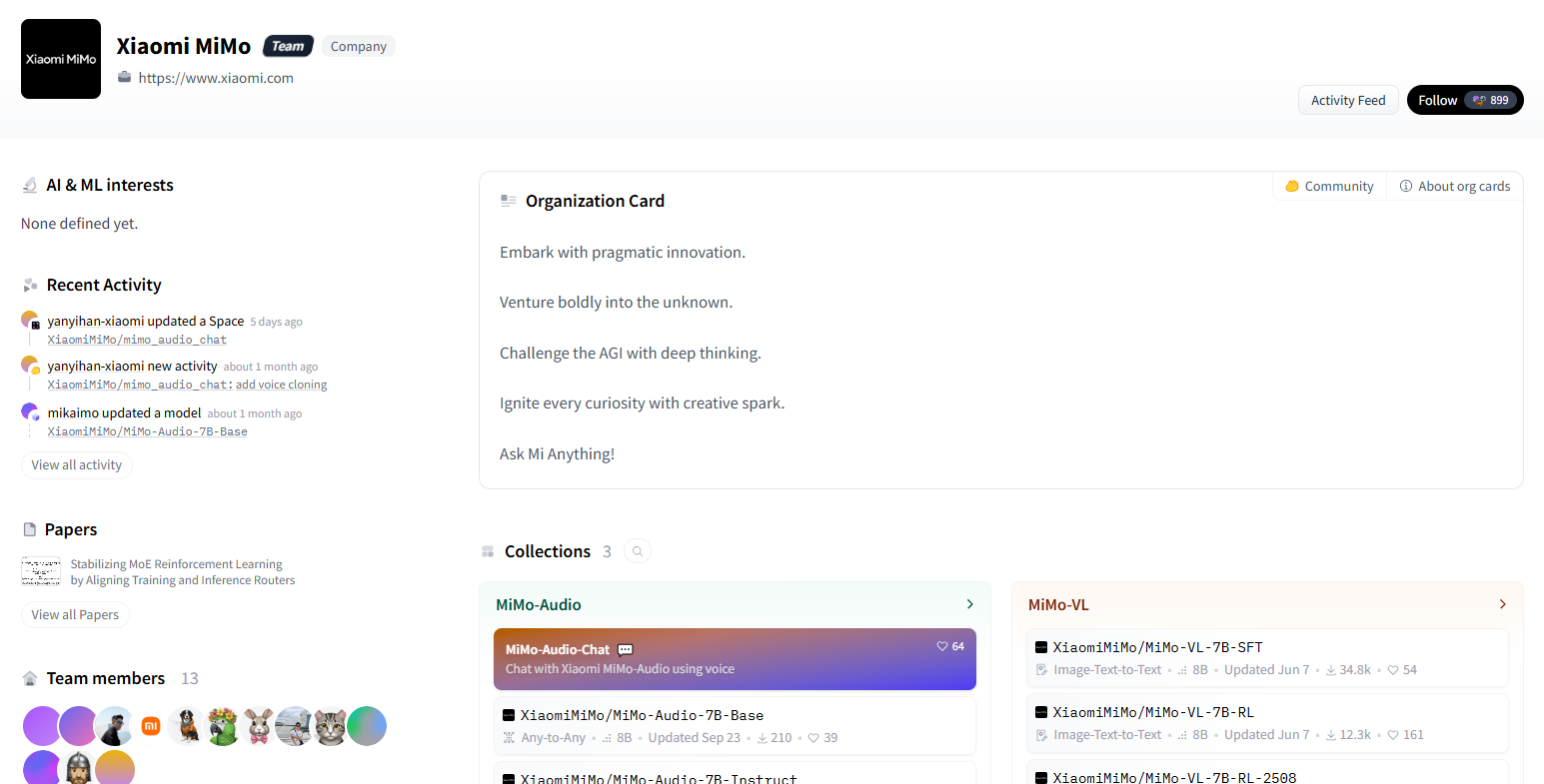

Xiaomi MiMo:小米开源的开源大模型,专注于推理能力

小米在2025年4月底开源了其首个推理大模型 Xiaomi MiMo,它以其 “以小博大” 的特点引起了广泛关注。虽然参数规模不大,但在多项权威测试中超越了参数规模更大的知名模型。

| 维度 | 详细说明 |

|---|---|

| 核心定位 | 专注于推理能力的开源大模型 |

| 发布公司 | 小米 |

| 开源时间 | 2025年4月30日 |

| 参数规模 | 7B (70亿参数) |

| 核心功能 | 数学推理、代码生成 |

| 技术亮点 | 预训练与后训练联动机制、Test Difficulty Driven Reward (TDDR) 算法 |

| 突出成绩 | 在数学推理(AIME 24-25)和代码竞赛(LiveCodeBench v5)测评中,性能超过了OpenAI的o1-mini及阿里通义千问的QwQ-32B-Preview模型 |

🧠 聚焦推理能力的技术突破

Xiaomi MiMo 的核心能力体现在其深度推理上,这得益于其在数据和算法上的组合创新:

-

高质量的预训练数据:模型在训练阶段累计使用了25万亿tokens(25T tokens) 的数据。更为关键的是,其中有大约2000亿tokens(200B tokens) 是专门为推理任务合成的数据,这让模型在初期就“见过”更多的推理模式。

-

创新的后训练算法:在后训练(特别是强化学习阶段),小米团队引入了 Test Difficulty Driven Reward (TDDR) 机制。这个机制会将测试用例按难度分组,并根据难度为模型分配奖励,以此缓解困难算法问题中的奖励稀疏问题,引导模型更好地攻克难题。同时,采用的 Easy Data Re-Sampling 策略也有助于稳定训练过程。

🚀 卓越的性能表现

尽管参数规模不大,但Xiaomi MiMo在多项权威基准测试中表现出色,实现了“小参数,大能力”的目标:

-

数学推理:在AIME 24-25测评集上,MiMo取得了67.8%的正确率。

-

代码生成:在LiveCodeBench v5测评集上,通过率达到了89.1%。

这一成绩使其在特定任务上的表现超越了参数规模更大的对手,例如OpenAI的闭源推理模型o1-mini和阿里通义千问320亿参数的QwQ-32B-Preview模型。

💡 小米的AI战略与MiMo的角色

Xiaomi MiMo的发布也体现了小米在AI领域的整体战略布局:

-

专注端侧,轻量化部署:与许多厂商追求庞大的参数规模不同,小米大模型主攻轻量化和本地部署。小米创始人雷军曾表示,将大模型能力下放到设备端侧,能更好地保护用户隐私,并有机会在本地实现千人千面的个性化定制。Xiaomi MiMo正是这一思路的实践,其低功耗和低延迟的特性使其能够适配手机等移动设备。

-

赋能自身硬件生态:小米致力于将大模型与自身业务深度协同。目前,MiMo的推理能力已逐步接入手机、汽车、AIoT、机器人等业务板块,通过端侧赋能加速智能体验。例如,有资料显示,MiMo已深度嵌入小米HyperOS系统服务层,用户可通过“思维模式”实现离线数学解题、代码片段生成等功能。

-

坚定的研发投入:小米在AI领域的投入巨大。据报道,2025年小米将投入70亿元以上资金用于AI研发,约占总研发经费的四分之一。同时,小米也搭建了自己的GPU万卡集群,为大规模模型研发提供算力保障。

Xiaomi MiMo:小米开源的开源大模型,专注于推理能力